贝叶斯优化

Hyperparameters 超参的调整是 Deep Learning 较为耗时的一部分。比起 grid search 耗时耗力的暴力破解与 random search 的若有缘则相见。贝叶斯优化提供了一种相对有方向的搜索方案。

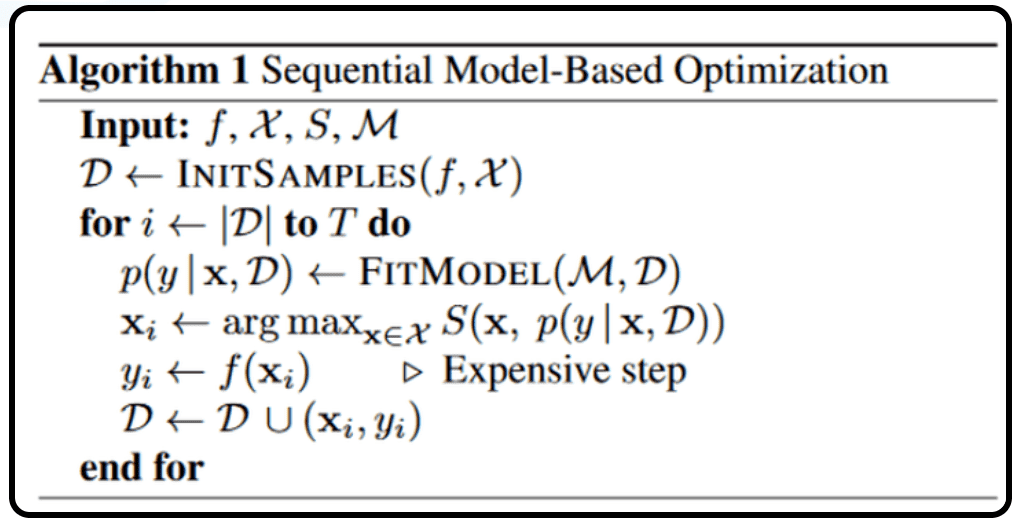

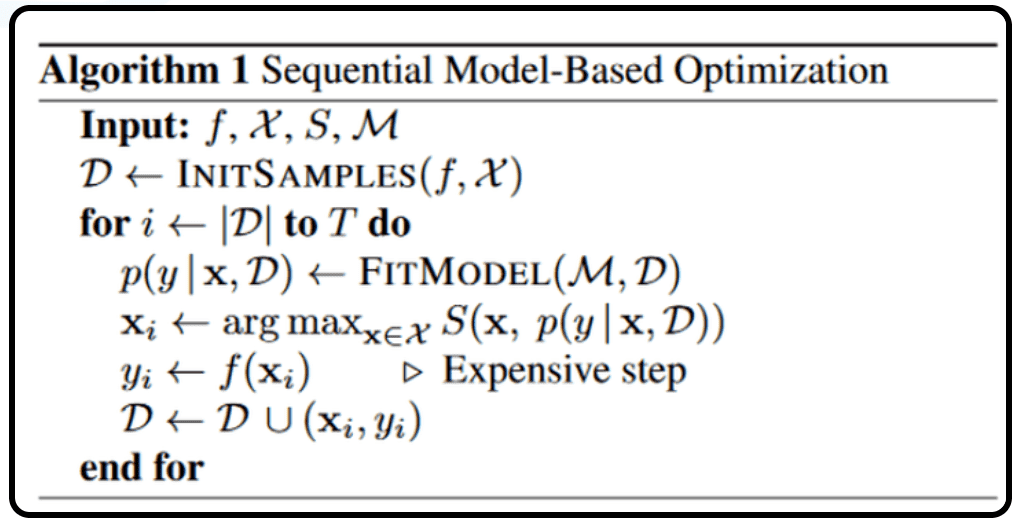

算法大致思路

大约 5 分钟

Hyperparameters 超参的调整是 Deep Learning 较为耗时的一部分。比起 grid search 耗时耗力的暴力破解与 random search 的若有缘则相见。贝叶斯优化提供了一种相对有方向的搜索方案。

Basic Deep Learning math for Coursera Course Deep Learning by Andrew Ng, Kian Katanforoosh and Younes Bensouda Mourri.

Please expect some loading time due to math formula.